Milano 27 Aprile 2026

La lavanda è un profumo che a Gaza odora di morte. Il gospel non è solo parola di Dio, ma anche una forza malefica che viene dal cielo e semina distruzione e terrore sempre a Gaza e dintorni. Palantir non è solo una parola elfica dell’universo fantastico di Tolkien, che significa “pietre veggenti”. È anche un sistema di intelligenza artificiale che analizza il campo di battaglia e consente di identificare gli obiettivi da colpire a Gaza, in Libano, in Iran.

Semmai ci fossimo illusi che Intelligenza Artificiale significasse solo creazione di musica, immagini, romanzi, poesie e aiutasse a imparare, è giunta l’ora di ricrederci definitivamente. I nomi sono conseguenza delle cose, come diceva la locuzione latina nomina sunt consequentia rerum. Solo che oggi Lavender, Gospel, Palantir significano ben altro. Come dimostra e conferma la guerra israelo-americana contro l’Iran basata sull’Intelligenza Artificiale, scoppiata Il 28 febbraio.

Secondo il Comando militare centrale (Centcom), gli Stati Uniti hanno colpito più di 5mila obiettivi durante i primi 10 giorni di attacco. Questo, soprattutto, grazie al sistema Project Maven, fondato sulla tecnologia di Palantir Technologies, azienda di Denver im Colorado. Un’indagine militare preliminare ha concluso che l’attacco alla scuola femminile nel sud dell’Iran, in cui sono morte 170 persone, per lo più bambine, è stato probabilmente causato da informazioni di intelligence obsolete di questo sistema Maven.

Israele già prima aveva contrassegnato oltre 37mila palestinesi come obiettivi militari, usando il sistema di Intelligenza Artificiale noto come Lavender, sottoposto a una limitata supervisione umana, incurante di eventuale vittime collaterali. Si tratta è, infatti, di un database che incrocia le informazioni relative a persone ritenute vicine alle milizie palestinesi. Con conseguenze anche sui civili. Il processo di autorizzare a colpire i target segnalati dall’AI stabilisce che sia accettabile un numero tra 15 e 20 vittime collaterali per ogni miliziano di Hamas, o della Jihad islamica palestinese, ucciso. E fino a 100 vittime civili collaterali per ogni alto funzionario colpito.

Invece, per polverizzare edifici e strutture militari e annientare miliziani di basso rango, l’esercito israeliano ricorre a un altro sistema di AI: quello denominato Gospel.

Un esperto di guerra moderna, Craig Jones, docente di Geografia Politica presso l’università di Newcastle e autore di The War Lawyers: The United States, Israel, and Juridical Warfare intervistato dal sito Democracynow.org, afferma che la tecnologia dell’intelligenza artificiale sta aiutando gli eserciti ad accelerare la “catena di eliminazione”, ovvero il processo di identificazione, approvazione e attacco dei bersagli.

Conferma Luca Anedda, 68 anni, cagliaritano, tenente colonnello pilota dell’ Aeronautica Militare e poi comandante di aviazione commerciale: «La guerra moderna, in particolare quella di Washington e Tel Aviv in Iran, Gaza e Libano, ha avuto un’evoluzione terrificante sia nella fase di “targhetizzazione” (identificazione degli obiettivi, ndr), sia nell’esecuzione. Ora viene condotta con droni e missili. Un primo segnale si era avuto nel 2020 nel conflitto del Nagorno-Karabak fra azeri e armeni. L’Azerbaijan fece uso dei droni israeliani e turchi che si rivelarono decisivi. Poi è venuta la guerra in Ucraina dove il ricorso agli automi ha sostituito i classici bombardamenti». Anedda, ancora impegnato nella sua attività di istruttore, dopo esserlo stato nella scuola Nato di Sheppard, in USA, dove aveva conseguito il brevetto di pilota militare, continua: «È finita l’epoca in cui si cercavano i punti da colpire con satelliti e aerei spia e esaminando le mappe. Anche noi in Italia avevamo uno stormo nella base di Villafranca specializzato in questa ricerca. Un lavoro che impegnava tanto personale sia in volo sia a terra. Ora grazie alla IA si sta riducendo un enorme carico di lavoro umano, si automatizzano le decisioni di individuazione dei bersagli. Il che solleva problemi legali, etici e politici, di cui Israele e Usa non sembrano curarsi molto».

Una conferma la si è avuta il 9 marzo scorso, quando il vice segretario alla Difesa, Steve Feinberg, 66 anni, ha comunicato ai vertici militari che il sistema di Intelligenza Artificiale Maven smart system di Palantir diventava un programma ufficiale del Pentagono.

In pratica, il passaggio dell’esercito yankee verso l’AI come strumento primario per aumentare il ritmo della guerra moderna, perché «Questa piattaforma – secondo la Difesa americana – fornirà gli strumenti più avanzati per rilevare e dominare i nostri avversari visto che è in grado di analizzare enormi quantità di dati provenienti da satelliti, droni, radar, sensori e rapporti di intelligence, utilizzando l’IA per identificare automaticamente potenziali minacce o obiettivi».

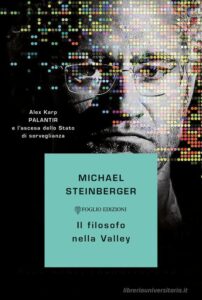

Palantir Technologies, come è ben chiarito anche nel recente libro su uno dei suoi fondatori e ora amministratore, Alex Carp, 58 anni (Il filosofo nella Valley – Alex Karp, Palantir e l’ascesa dello Stato di sorveglianza di Michael Steinberger, Foglio edizioni) ha fatto la sua fortuna con l’analisi di dati e con la gestione di questi da parte di governi e organismi internazionali. Ha contratti con la CIA, con il Sistema Sanitario Inglese, ha gestito l’operazione della polizia di frontiera contro americani immigrati (ICE). Ha scritto Francesco Arruzzoli, responsabile Centro studi Cyber Defense, Cerbeyra su ictsecuritymagazine.com: «I suoi contratti con CIA, FBI e Dipartimento della Difesa non si misurano in milioni: si misurano in miliardi».

Aggiunge con una punta di amarezza il tenente colonnello Luca Anedda: «Saremo in balia delle macchine. L’ uomo non ha il tempo materiale di intervenire una volta che AI ha preso la decisione. Si fa fatica a controllare quello che ha elaborato. Un esempio è proprio l’attacco alla scuola femminile iraniana. E, purtroppo, sembra caduta ogni remora. Il 27 settembre scorso, Pete Hegseth, Segretario alla Difesa, o della Guerra, incontrando i vertici militari ha dichiarato: “”il politicamente corretto è finito”. Come dire: non combatterete più con il freno a mano tirato. Eppure un militare ha un’etica, regole, convenzioni da rispettare, a cominciare da quella di Ginevra. Il fatto di essere armato non significa licenza di uccidere. Il nemico si combatte, ma non la gente inerme. Quando si prepara un piano di attacco non sono previsti obiettivi civili. Ricordo un episodio della guerra del Kosovo. Un nostro Tornado doveva bombardare un ponte. Quando stava per sganciare vide che sopra passava un camion. Aspettò che si allontanasse prima di portare a termine la missione. Così facendo però rischio di essere abbattuto dalla contraerea. Il militare ha giurato sulla patria, sulla costituzione e il rispetto delle norme etico legali. Con Palantir, questo, può essere aggirato. Non è un caso se, in questi mesi, molti alti ufficiali americani si sono dimessi, o sono stati spinti ad andarsene, perché in disaccordo con la nuova linea del Pentagono».

La decisione di formalizzare il ruolo di Palantir segue un periodo di tensioni tra il Pentagono e altri attori dell’Intelligenza Artificiale della Silicon Valley. Proprio il giorno prima dell’offensiva anti-Iran, il governo USA aveva messo da parte, praticamente “scomunicandolo”, uno dei suoi principali fornitori di AI, Anthropic, perché aveva sollevato preoccupazioni etiche. Anche Humans Wright Watch e esperti dell’ONU hanno contestato l’accordo con Palantir. A squarciare il velo di Maya ci pensa Francesco Vignarca, 52 anni, lombardo, da decenni impegnato nella “guerra alle guerre” e nelle politiche non violente. «In tanti si stanno svegliando ora – commenta Vignarca, che è il coordinatore delle Campagne nella Rete Italiana Pace e Disarmo (RIPD) – .Noi già nel 2013 nella campagna “stop killer robots” avevamo denunciato i droni armati, le armi autonome, la sempre maggiore automazione dei sistemi di armi. Anche la Chiesa, con Papa Francesco e papa Leone non smette di evidenziare questa realtà».

E chiarisce: «Certo, dicono che ci sono i controlli umani, perché l’ok finale viene dato da un militare, ma purtroppo non è sufficiente. I rischi sono elevati e ci si affida troppo all’Intelligenza artificiale. Questa è la direzione intrapresa. E non è un caso che oggi i contractor del Pentagono non siano le grandi aziende produttrici di armi, ma i giganti tecnologici».

Immagine di apertura: fonte: Avvenire